Chi -squared distribution - Chi-squared distribution

|

Sannolikhetstäthetsfunktion

| |||

|

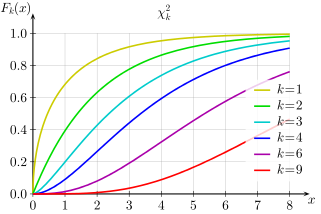

Kumulativ fördelningsfunktion

| |||

| Notation | eller | ||

|---|---|---|---|

| Parametrar | (känd som "frihetsgrader") | ||

| Stöd | om annars | ||

| CDF | |||

| Betyda | |||

| Median | |||

| Läge | |||

| Variation | |||

| Snedhet | |||

| Ex. kurtos | |||

| Entropi | |||

| MGF | |||

| CF | |||

| PGF | |||

I sannolikhetsteori och statistik är chi-kvadratfördelningen (även chi-kvadrat eller χ 2- fördelning ) med k frihetsgrader fördelningen av en summa av kvadraterna för k oberoende normala slumpmässiga variabler. Chi-kvadratfördelningen är ett specialfall för gammafördelningen och är en av de mest använda sannolikhetsfördelningarna inom inferentiell statistik , särskilt vid hypotesprovning och konstruktion av konfidensintervall . Denna fördelning kallas ibland den centrala chi-kvadratiska fördelningen , ett speciellt fall av den mer allmänna icke-centrala chi-kvadratiska fördelningen .

Chi-kvadrat distribution används i de gemensamma chi-kvadrattester för goodness of fit av en observerad distribution till ett teoretiska kan den oberoende av två kriterier för klassificering av kvalitativa data , och i konfidensintervall uppskattning för en population standardavvikelse av en normalfördelning från ett urval standardavvikelse. Många andra statistiska tester använder också denna fördelning, till exempel Friedmans analys av varians efter rang .

Definitioner

Om Z 1 , ..., Z k är oberoende , normala normala slumpmässiga variabler, då summan av deras kvadrater,

fördelas enligt chi-kvadratfördelningen med k frihetsgrader. Detta brukar betecknas som

Chi-kvadratfördelningen har en parameter: ett positivt heltal k som anger antalet frihetsgrader (antalet slumpmässiga variabler som summeras, Z i s).

Introduktion

Chi-kvadratfördelningen används främst vid hypotesprovning, och i mindre utsträckning för konfidensintervall för populationsvarians när den underliggande fördelningen är normal. Till skillnad från mer kända fördelningar som normalfördelningen och den exponentiella fördelningen tillämpas inte chi-kvadratfördelningen lika ofta vid direkt modellering av naturfenomen. Det uppstår bland annat i följande hypotesprov:

- Chi-squared test av oberoende i beredskapstabeller

- Chi-kvadrat test av hur bra passformen av observerade data till hypotetiska fördelningar

- Sannolikhetstest för kapslade modeller

- Log-rank test i överlevnadsanalys

- Cochran – Mantel – Haenszel test för stratifierade beredskapstabeller

Det är också en komponent i definitionen av t-distributionen och F-distributionen som används i t-tester, variansanalyser och regressionsanalyser.

Den främsta orsaken till att chi-kvadratfördelningen används i stor utsträckning vid hypotesprovning är dess relation till normalfördelningen. Många hypotesprov använder en teststatistik, till exempel t-statistiken i ett t-test. För dessa hypotesprov när provstorleken, n, ökar, närmar sig provtagningsfördelningen för teststatistiken normalfördelningen ( centralgränsvärdet ). Eftersom teststatistiken (t.ex. t) är asymptotiskt normalfördelad, förutsatt att provstorleken är tillräckligt stor, kan fördelningen som används för hypotesprovning approximeras av en normalfördelning. Att testa hypoteser med en normalfördelning är väl förstådd och relativt lätt. Den enklaste chi-kvadratiska fördelningen är kvadraten i en standard normalfördelning. Så varhelst en normalfördelning kan användas för ett hypotesprov, kan en chi-kvadratfördelning användas.

Antag att är en slumpvariabel prov från standardnormalfördelning, där medelvärdet är och variansen är : . Tänk nu på den slumpmässiga variabeln . Fördelningen av den slumpmässiga variabeln är ett exempel på en chi-kvadratfördelning: Abonnemanget 1 indikerar att just denna chi-kvadratiska fördelning är konstruerad av endast 1 standard normalfördelning. En chi-kvadratfördelning konstruerad genom att kvadrera en enda standard normalfördelning sägs ha 1 frihetsgrad. Alltså, när provstorleken för ett hypotesprov ökar, närmar sig fördelningen av teststatistiken en normalfördelning. Precis som extrema värden för normalfördelningen har låg sannolikhet (och ger små p-värden), har extrema värden för chi-kvadratfördelningen låg sannolikhet.

En ytterligare anledning till att chi-kvadratfördelningen används i stor utsträckning är att den visar sig som den stora provfördelningen av generaliserade sannolikhetstest (LRT). LRT har flera önskvärda egenskaper; i synnerhet ger enkla LRT vanligtvis den högsta kraften att avvisa nollhypotesen ( Neyman – Pearson lemma ) och detta leder också till optimalt egenskaper hos generaliserade LRT. De normala och chi-kvadratiska approximationerna är dock endast giltiga asymptotiskt. Av denna anledning är det att föredra att använda t-fördelningen snarare än den normala approximationen eller den chi-kvadrerade approximationen för en liten provstorlek. På samma sätt kommer analyserna av beredskapstabeller att chi-kvadrat-approximationen vara dålig för en liten provstorlek, och det är att föredra att använda Fishers exakta test . Ramsey visar att det exakta binomiala testet alltid är kraftfullare än den normala approximationen.

Lancaster visar kopplingarna mellan de binomiala, normala och chi-kvadratiska fördelningarna enligt följande. De Moivre och Laplace konstaterade att en binomial fördelning kan approximeras med en normal fördelning. Specifikt visade de den asymptotiska normaliteten hos den slumpmässiga variabeln

var är det observerade antalet framgångar i prövningar, där sannolikheten för framgång är och .

Kvadrering på båda sidor av ekvationen ger

Genom att använda , och kan denna ekvation skrivas om som

Uttrycket till höger är av den form som Karl Pearson skulle generalisera till formen

var

- = Pearsons kumulativa teststatistik, som asymptotiskt närmar sig en distribution.

- = antalet observationer av typ .

- = den förväntade (teoretiska) typfrekvensen , hävdad av nollhypotesen att fraktionen av typ i befolkningen är

- = antalet celler i tabellen.

Vid ett binomiskt utfall (vändning av ett mynt) kan binomialfördelningen approximeras med en normalfördelning (för tillräckligt stor ). Eftersom kvadraten för en normal normalfördelning är chi-kvadratfördelningen med en frihetsgrad, kan sannolikheten för ett resultat som 1 huvuden i 10 försök approximeras antingen genom att använda normalfördelningen direkt eller chi-kvadratfördelningen för den normaliserade, kvadratiska skillnaden mellan observerat och förväntat värde. Många problem innebär emellertid mer än de två möjliga resultaten av ett binomial, och kräver istället tre eller flera kategorier, vilket leder till multinomial distribution. Precis som de Moivre och Laplace sökte efter och hittade den normala approximationen till binomialet, sökte och hittade Pearson en degenererad multivariat normal approximation till multinomialfördelningen (siffrorna i varje kategori uppgår till den totala provstorleken, som anses vara fixerad) . Pearson visade att chi-kvadratfördelningen uppstod från en sådan multivariat normal approximation till multinomial distribution, med noggrann hänsyn till det statistiska beroendet (negativa korrelationer) mellan antalet observationer i olika kategorier.

Sannolikhetstäthetsfunktion

Den funktionen sannolikhetstätheten (pdf) av chitvåfördelning är

där betecknar gammafunktionen , som har slutna formvärden för heltal .

För härledningar av pdf-filen i fallet med en, två och frihetsgrader, se Bevis relaterade till distribution av chi-kvadrat .

Kumulativ fördelningsfunktion

Dess kumulativa distributionsfunktion är:

var är den lägre ofullständiga gammafunktionen och är den reglerade gammafunktionen .

I ett specialfall av = 2 har denna funktion den enkla formen:

som enkelt kan härledas genom att integrera direkt. Hela talets återkommande gamma -funktion gör det enkelt att beräkna för andra små, jämna .

Tabeller för den ki-kvadrerade kumulativa distributionsfunktionen är allmänt tillgängliga och funktionen ingår i många kalkylblad och alla statistiska paket .

Uthyrning , Chernoff -gränser på CDF: s nedre och övre svans kan erhållas. För de fall då (som inkluderar alla de fall då denna CDF är mindre än hälften):

Svansen bunden för de fall när , på liknande sätt, är

För en annan approximation för CDF modellerad efter kuben av en Gaussian, se under Noncentral chi-squared distribution .

Egenskaper

Summan av kvadrater av oberoende identiskt fördelade normala slumpmässiga variabler minus deras medelvärde

Om Z 1 , ..., Z k är oberoende identiskt fördelade (iid), normala normala slumpmässiga variabler, då

var

Additivitet

Det följer av definitionen av chi-squared-distributionen att summan av oberoende chi-squared-variabler också är chi-squared-distribuerad. Närmare bestämt, om är oberoende chi-kvadrat variabler med , frihetsgrader, respektive, då är chi-squared fördelat med grader av frihet.

Provmedelvärde

Provmedelvärdet för iid chi- squared -variabler i grad fördelas enligt en gammafördelning med form- och skalparametrar:

Asymptotiskt , med tanke på att för en skalparameter som går till oändlighet, konvergerar en gammadistribution mot en normalfördelning med förväntan och varians , konvergerar medelvärdet mot:

Notera att vi skulle ha erhållit samma resultat som åberopar istället den centrala gränsvärdessatsen , att notera att för varje chi-kvadrat variabel av grad förväntningen är , och dess varians (och följaktligen variansen av provet medelvärdet varelse ).

Entropi

Den differentiella entropi ges av

där ψ ( x ) är Digamma -funktionen .

Chi-kvadratfördelningen är den maximala entropi-sannolikhetsfördelningen för en slumpmässig variant för vilken och är fixerade. Eftersom chi-kvadraten är i familjen av gammadistributioner kan detta härledas genom att ersätta lämpliga värden i förväntningen på loggmomentet för gamma . För härledning från mer grundläggande principer, se härledningen i momentgenererande funktion av tillräcklig statistik .

Icke -centrala stunder

Stunderna om noll i en chi-kvadratisk fördelning med frihetsgrader ges av

Kumulanter

De kumulanter erhålles lätt genom en (formell) potensserie expansionen av logaritmen av den karakteristiska funktionen:

Koncentration

Chi-kvadratfördelningen uppvisar stark koncentration kring medelvärdet. Standardgränserna för Laurent-Massart är:

Asymptotiska egenskaper

Genom den centrala gränssatsen , eftersom chi-kvadratfördelningen är summan av oberoende slumpmässiga variabler med ändligt medelvärde och varians, konvergerar den till en normalfördelning för stora . För många praktiska ändamål är distributionen tillräckligt nära en normal fördelning för att skillnaden ska ignoreras. Specifikt, om , då som går mot oändligheten, fördelningen av tenderar till en standardnormalfördelning. Konvergensen är emellertid långsam som skevheten är och överskottet av kurtos är .

Samplingsfördelningen av konvergerar till normalitet mycket snabbare än samplingsfördelningen av , eftersom logaritmen tar bort mycket av asymmetrin. Andra funktioner i chi-kvadratfördelningen konvergerar snabbare till en normal fördelning. Några exempel är:

- Om då är ungefär normalt fördelat med medelvärde och enhetsvarians (1922, av RA Fisher , se (18.23), s. 426 i Johnson.

- Om då ungefär är normalfördelat med medelvärde och varians Detta kallas Wilson – Hilferty -transformationen, se (18.24), sid. 426 av Johnson.

- Denna normaliserande transformation leder direkt till den vanliga median approximationen genom att back-transformera från medelvärdet, som också är medianen, för normalfördelningen.

Relaterade distributioner

- Som , ( normalfördelning )

- ( noncentral chi-squared distribution med icke-centralitetsparameter )

- Om då har chi-squared distributionen

- Som ett specialfall, om då har chi-squared distributionen

- (Den kvadrerade normen av k standardnormalfördelade variabler är en chitvåfördelning med k frihetsgrader )

- Om och , då . ( gamma distribution )

- Om då ( chi distribution )

- Om , då är en exponentiell distribution . (Se gammadistribution för mer.)

- Om , då är en Erlang -distribution .

- Om , då

- Om ( Rayleigh distribution ) då

- Om ( Maxwell distribution ) då

- Om då ( Invers-chi-squared distribution )

- Chi-squared-distributionen är ett specialfall av typ III Pearson-distribution

- Om och är oberoende då ( beta -distribution )

- Om ( enhetlig fördelning ) då

- Om då

- Om följer den generaliserade normalfördelningen (version 1) med parametrar då

- chi-squared distribution är en transformation av Pareto distribution

- Studentens t-distribution är en transformation av chi-squared distribution

- Studentens t-distribution kan erhållas från chi-squared distribution och normal distribution

- Noncentral beta-distribution kan erhållas som en transformation av chi-squared distribution och Noncentral chi-squared distribution

- Noncentral t-distribution kan erhållas från normalfördelning och chi-squared-distribution

En chi-kvadrerad variabel med frihetsgrader definieras som summan av kvadraterna för oberoende normala slumpmässiga variabler.

Om är en -dimensionell Gaussisk slumpmässig vektor med medelvektor och rangkovariansmatris , är chi -kvadrat fördelat med frihetsgrader.

Summan av kvadrater av statistiskt oberoende enhetsvarians Gaussiska variabler som inte har medelvärde noll ger en generalisering av chi-kvadratfördelningen som kallas den icke-centrala chi-kvadratiska fördelningen .

Om är en vektor av iid normala slumpmässiga variabler och är en symmetrisk , idempotent matris med rang , så är den kvadratiska formen chi-square fördelad med frihetsgrader.

If är en positiv -semidefinit kovariansmatris med strikt positiva diagonala poster, för och en slumpmässig -vektor oberoende av sådant och det håller att

Chi-kvadratfördelningen är också naturligt relaterad till andra distributioner som härrör från Gaussian. Särskilt,

- är F-fördelad , om , var och är statistiskt oberoende.

- Om och är statistiskt oberoende, då . Om och inte är oberoende, distribueras inte chi-square.

Generaliseringar

Chi-kvadratfördelningen erhålls som summan av kvadraterna för k oberoende, nollmedelsvärde, enhetsvarians Gauss slumpmässiga variabler. Generaliseringar av denna fördelning kan erhållas genom att summera kvadraterna för andra typer av gaussiska slumpmässiga variabler. Flera sådana fördelningar beskrivs nedan.

Linjär kombination

Om är chi kvadrat slumpmässiga variabler och , då är ett slutet uttryck för distributionen av inte känt. Det kan emellertid approximeras effektivt med hjälp av egenskapen för karakteristiska funktioner för slumpmässiga variabler med chi-kvadrat.

Chi-kvadratiska fördelningar

Noncentral chi-squared distribution

Den icke-centrala chi-kvadratiska fördelningen erhålls från summan av kvadraterna för oberoende gaussiska slumpmässiga variabler med enhetsvarians och icke- nollmedel.

Generaliserad distribution av chi-kvadrat

Den generaliserade chikvadratfördelningen erhålls från den kvadratiska formen z′Az där z är en nollmedels Gauss-vektor med en godtycklig kovariansmatris, och A är en godtycklig matris.

Chi-kvadratfördelningen är ett specialfall av gammafördelningen , genom att använda hastighetsparameteriseringen av gammafördelningen (eller med hjälp av skalparametriseringen av gammafördelningen) där k är ett heltal.

Eftersom den exponentiella distributionen också är ett specialfall för gamma -distributionen, har vi också att om , då är en exponentiell distribution .

Den Erlang fördelning är också ett specialfall av gammafördelningen och därmed har vi också att om med ännu , då är Erlang distribueras med formparametern och skalparameter .

Förekomst och applikationer

Den chitvåfördelning har många tillämpningar inom trend statistik , till exempel i chi-kvadrat tester och att uppskatta avvikelser . Det går in i problemet med att uppskatta medelvärdet för en normalt fördelad befolkning och problemet med att uppskatta lutningen för en regressionslinje via dess roll i Studentens t-fördelning . Den går in i alla analyser av variansproblem via sin roll i F-distributionen , som är fördelningen av förhållandet mellan två oberoende chi-kvadrat- slumpmässiga variabler , var och en dividerad med sina respektive frihetsgrader.

Nedan följer några av de vanligaste situationerna där chi-kvadratfördelningen härrör från ett Gauss-fördelat prov.

- om är iid slumpmässiga variabler , då var .

- Rutan nedan visar lite statistik baserad på oberoende slumpmässiga variabler som har sannolikhetsfördelningar relaterade till chi-kvadratfördelningen:

| namn | Statistisk |

|---|---|

| chi-squared distribution | |

| noncentral chi-squared distribution | |

| chi -distribution | |

| icke -central chi -distribution |

Chi-kvadratfördelningen förekommer också ofta vid magnetisk resonansavbildning .

Beräkningsmetoder

Tabell över values 2 värden vs p -värden

Den p -värdet är sannolikheten att observera en provutfallets minst lika extrema i en chi-kvadrat distribution. Eftersom den kumulativa fördelningsfunktionen (CDF) för lämpliga frihetsgrader (df) ger sannolikheten för att ha erhållit ett värde som är mindre extremt än denna punkt, så subtraherar CDF -värdet från 1 p -värdet. Ett lågt p -värde, under den valda signifikansnivån, indikerar statistisk signifikans , dvs tillräckligt med bevis för att avvisa nollhypotesen. En signifikansnivå på 0,05 används ofta som avgränsning mellan signifikanta och icke-signifikanta resultat.

Tabellen nedan ger ett antal p -värden som matchar de första 10 frihetsgraderna.

| Frihetsgrader (df) | värde | ||||||||||

|---|---|---|---|---|---|---|---|---|---|---|---|

| 1 | 0,004 | 0,02 | 0,06 | 0,15 | 0,46 | 1,07 | 1,64 | 2,71 | 3,84 | 6,63 | 10,83 |

| 2 | 0,10 | 0,21 | 0,45 | 0,71 | 1,39 | 2.41 | 3.22 | 4,61 | 5,99 | 9.21 | 13,82 |

| 3 | 0,35 | 0,58 | 1,01 | 1,42 | 2,37 | 3,66 | 4,64 | 6,25 | 7,81 | 11.34 | 16.27 |

| 4 | 0,71 | 1,06 | 1,65 | 2,20 | 3,36 | 4,88 | 5,99 | 7,78 | 9.49 | 13.28 | 18.47 |

| 5 | 1.14 | 1,61 | 2,34 | 3,00 | 4,35 | 6.06 | 7.29 | 9.24 | 11.07 | 15.09 | 20.52 |

| 6 | 1,63 | 2,20 | 3.07 | 3,83 | 5.35 | 7.23 | 8.56 | 10,64 | 12.59 | 16.81 | 22.46 |

| 7 | 2.17 | 2,83 | 3,82 | 4,67 | 6,35 | 8,38 | 9,80 | 12.02 | 14.07 | 18.48 | 24.32 |

| 8 | 2,73 | 3,49 | 4.59 | 5.53 | 7.34 | 9.52 | 11.03 | 13.36 | 15.51 | 20.09 | 26.12 |

| 9 | 3,32 | 4.17 | 5.38 | 6,39 | 8,34 | 10,66 | 12.24 | 14,68 | 16,92 | 21,67 | 27,88 |

| 10 | 3,94 | 4,87 | 6.18 | 7.27 | 9.34 | 11,78 | 13.44 | 15,99 | 18.31 | 23.21 | 29.59 |

| p -värde (sannolikhet) | 0,95 | 0,90 | 0,80 | 0,70 | 0,50 | 0,30 | 0,20 | 0,10 | 0,05 | 0,01 | 0,001 |

Dessa värden kan beräknas för att utvärdera den kvantila funktionen (även känd som "invers CDF" eller "ICDF") för chi-kvadratfördelningen; t.ex. χ 2 ICDF för p = 0,05 och df = 7 utbyten 2,1673 ≈ 2,17 som i tabellen ovan, märker att en - p är p -värdet från tabellen.

Historia

Denna fördelning beskrevs först av den tyska statistikern Friedrich Robert Helmert i papper från 1875–6, där han beräknade samplingsfördelningen av provvariansen för en normal befolkning. Således på tyska var detta traditionellt känt som Helmert'sche ("Helmertian") eller "Helmert distribution".

Distributionen återupptogs oberoende av den engelska matematikern Karl Pearson i samband med passform , för vilken han utvecklade sitt Pearsons chi-squared-test , publicerat år 1900, med en beräknad tabell över värden publicerade i ( Elderton 1902 ), samlad i ( Pearson 1914 , s. Xxxi – xxxiii, 26–28, tabell XII) . Namnet "chi-square" härstammar slutligen från Pearsons stenografi för exponenten i en multivariat normalfördelning med den grekiska bokstaven Chi och skriver ½½ 2 för vad som skulle visas i modern notation som −½ x T Σ −1 x (Σ är kovariansmatris ). Idén om en familj med "chi-squared distributioner" beror dock inte på Pearson utan uppstod som en vidareutveckling på grund av Fisher på 1920-talet.

Se även

- Chi distribution

- Skalad invers chi-kvadratisk distribution

- Cochrans sats

- F -fördelning

- Fishers metod för att kombinera oberoende tester av betydelse

- Gamma distribution

- Generaliserad distribution av chi-kvadrat

- Hotellings T -kvadratdistribution

- Noncentral chi-squared distribution

- Pearsons chi-squared-test

- Minskad chi-squared-statistik

- Studentens t -fördelning

- Wilks lambda -distribution

- Wishart distribution

Referenser

Vidare läsning

- Hald, Anders (1998). En historia av matematisk statistik från 1750 till 1930 . New York: Wiley. ISBN 978-0-471-17912-2.

- Elderton, William Palin (1902). "Tabeller för att testa hur bra teorin passar till observation" . Biometrika . 1 (2): 155–163. doi : 10.1093/biomet/1.2.155 .

- "Chi-squared distribution" , Encyclopedia of Mathematics , EMS Press , 2001 [1994]

externa länkar

- Tidigaste användningen av några av matematikens ord: posten på Chi i kvadrat har en kort historik

- Kursanteckningar om Chi-Squared Goodness of Fit Testing från Yale University Statistik 101-klass.

- Mathematisk demonstration som visar den chi-kvadratiska samplingsfördelningen av olika statistik, t.ex. Σ x ², för en normal befolkning

- Enkel algoritm för att approximera cdf och invers cdf för chi-squared-distributionen med en fickräknare

- Värden för Chi-kvadratfördelningen

![{\ displaystyle h = \ int _ {0}^{\ infty} f (x; \, k) \ ln f (x; \, k) \, dx = {\ frac {k} {2}}+\ l \ vänster [2 \, \ Gamma \ vänster ({\ frac {k} {2}} \ höger) \ höger]+\ vänster (1-{\ frac {k} {2}} \ höger) \, \ psi \! \ vänster [{\ frac {k} {2}} \ höger],}](https://wikimedia.org/api/rest_v1/media/math/render/svg/d6e76f96bba0f22fdb613c4dc8c6730942ee3a79)

![{\ displaystyle {\ sqrt [{3}] {X/k}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/8bcdb470ed5d9bcbb3a64104d190a9ff620f4048)